Профессиональная разработка платформы контейнеризации редко начинается с кода. Чаще все упирается в вопросы контроля, масштабирования и поддержки. Российская платформа контейнеризации «Боцман» создавалась именно под такие задачи – когда компании нужно не просто поднять Kubernetes, а выстроить управляемую систему с понятной архитектурой и SLA на инциденты.

Сама идея проста. Есть кластеры, есть сервисы и есть команды разработки. И все это должно работать без хаоса.

Где и как разворачивается платформа контейнеризации

Архитектура допускает несколько сценариев размещения. Это важно, потому что у компаний разные требования к инфраструктуре и безопасности. Возможные варианты такие:

• в Яндекс Облаке;

• на собственной инфраструктуре Bare Metal;

• ПАК на базе YADRO;

• ПАК на базе Аквариуса;

• VK Cloud;

• инфраструктура собственных провайдеров на VMware.

Выбор зависит от задач. Кому-то нужен публичный облачный контур. Кому-то важен полный контроль над оборудованием. Бывает, что сначала запускают пилот в облаке, а потом переносят в локальный контур. Такой путь встречается часто.

Когда одна команда переносила сервисы с тестового облака в локальный контур, они ожидали недельной паузы. Фактически переключение заняло несколько дней. Больше времени ушло на согласования, чем на техническую часть.

Платформа использует инструменты открытого ПО для управления мультикластерами Kubernetes. Это не закрытая экосистема. Поддерживаются операции:

установка кластеров;

• обновления;

• резервное копирование;

• тестирование изменений.

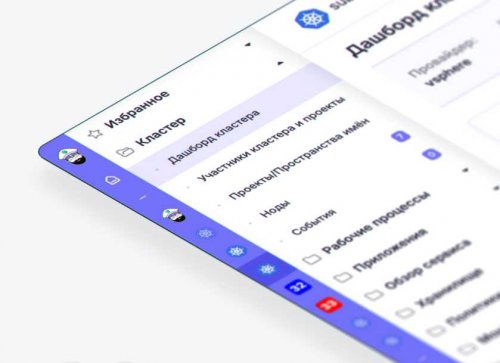

Причем управление возможно через каталог приложений, kubectl, API и CLI. Кто-то предпочитает графический интерфейс. Кто-то работает через консоль. Ограничений нет.

И это, честно говоря, снимает напряжение у DevOps-команд.

Какие задачи решает разработка платформы контейнеризации

Если смотреть шире, платформа нужна не ради самого Kubernetes. Она закрывает управленческие и эксплуатационные вопросы. Основные возможности выглядят так:

• централизованное управление мультикластерами Kubernetes;

• интеграция сервисов через единый пользовательский интерфейс;

• стандартизация процессов с использованием DevOps-подхода;

• каталог приложений и инструментов для разработчиков;

• строгие политики безопасности и аутентификации;

• поддержка от российского вендора.

Централизация снижает количество ручных действий. Интеграция упрощает взаимодействие сервисов. Стандартизация ускоряет внедрение новых релизов. Все звучит ожидаемо, но в реальных проектах именно на этих местах чаще всего возникают сбои.

Интересный момент связан с безопасностью. Политики аутентификации и разграничения доступа настраиваются на уровне всей платформы. Это избавляет от разрозненных конфигураций в каждом кластере. Хотя в крупных организациях процесс согласования прав доступа порой сложнее самой технической настройки.

Есть и организационный аспект. Поддержка предлагается в двух форматах – стандартный режим 9 часов 5 дней в неделю или премиальный 24/7. Для критичных сервисов круглосуточный формат обычно становится обязательным. Иначе риск просто слишком велик.

Внедрение проходит поэтапно. Сначала демонстрация и разворачивание одного приложения. Затем образовательный воркшоп для команды. После этого помощь в миграции и развертывании. И уже затем полноценная эксплуатационная поддержка.

Звучит линейно. На практике этапы могут пересекаться. Где-то команда быстрее осваивается. Где-то требуется дополнительная настройка CI/CD. Это нормально.

Был момент, когда разработчики скептически относились к централизованному управлению. Через месяц они уже просили добавить еще несколько кластеров в общий контур. Привычка к прозрачности появляется быстро.

Контейнерный оркестратор упрощает жизненный цикл приложений – от запуска до мониторинга. Масштабирование происходит без лишней ручной работы. Контроль над версиями сохраняется. А при необходимости кластер можно обновить без остановки всей системы. Хотя плановые окна обслуживания никто не отменял.

Иногда кажется, что контейнеризация давно стала стандартом. Это правда лишь частично. Настоящая сложность начинается тогда, когда кластеров больше одного. Вот тогда и становится понятно, зачем нужна полноценная платформа, а не набор разрозненных инструментов.

Частые вопросы о разработке платформы контейнеризации

Можно ли подключить существующие кластеры Kubernetes без полной миграции?

Да, при корректной настройке интеграции возможно подключение уже работающих кластеров. Важно проверить версии Kubernetes и совместимость используемых плагинов. Ошибки чаще всего возникают из-за кастомных сетевых настроек.

Что происходит при обновлении самой платформы?

Обновление проводится по регламенту и обычно не требует полной остановки сервисов. Тем не менее рекомендуется заранее протестировать изменения в отдельном контуре. Иногда сторонние плагины требуют ручной адаптации.

Подходит ли решение для изолированных контуров без выхода в интернет?

Да, но потребуется организация локального зеркала репозиториев и внутренней системы обновлений. Это увеличивает нагрузку на администрирование, зато позволяет работать в закрытой среде.

Как распределяется ответственность между заказчиком и вендором?

Техническая поддержка покрывает инциденты на уровне платформы. За конфигурацию приложений и бизнес-логики отвечает команда заказчика. Нюанс в том, что граница ответственности должна быть закреплена договором заранее.

Разработка платформы контейнеризации – это не про модный тренд. Это про управляемость, предсказуемость и поддержку. Когда инфраструктура перестает быть источником неожиданностей, команда может сосредоточиться на сервисах. И в этом главная ценность такого подхода.

Главная

Главная